Η μεγαλύτερη έρευνα για την AI αποκαλύπτει τι θέλουν πραγματικά οι άνθρωποι

- Οι άνθρωποι δεν θέλουν απλώς παραγωγικότητα — θέλουν χρόνο και καλύτερη ζωή.

- Η AI λειτουργεί ως εργαλείο πρόσβασης, μάθησης και ενδυνάμωσης.

- Τα οφέλη συνοδεύονται από φόβους για εξάρτηση και απώλεια σκέψης.

Η τεράστια μελέτη συνεντεύξεων της Anthropic για την τεχνητή νοημοσύνη δεν αφορά πραγματικά την τεχνολογία. Είναι ο μεγαλύτερος καθρέφτης που έχει στραφεί ποτέ προς την ανθρώπινη επιθυμία.

Τον Δεκέμβριο του 2025, ένας μηχανικός λογισμικού στο Μεξικό τελείωσε τη δουλειά του αρκετά νωρίς ώστε να πάρει τα παιδιά του από το σχολείο. Μια δικηγόρος στην Ινδία κάθισε με έναν AI tutor και, για πρώτη φορά στη ζωή της, διάβασε Σαίξπηρ χωρίς δισταγμό.

Ένας στρατιώτης στην Ουκρανία, άυπνος υπό βομβαρδισμούς, άνοιξε ένα παράθυρο συνομιλίας και άρχισε να μαθαίνει κάτι νέο, οτιδήποτε νέο, γιατί η μάθηση ήταν το μόνο που κρατούσε τον πανικό σε απόσταση.

Κανείς από αυτούς δεν γνώριζε τον άλλον. Όμως όλοι τους, μέσα στην ίδια εβδομάδα, συμμετείχαν σε μια ανοιχτή συνομιλία με έναν AI interviewer που δημιούργησε η Anthropic, η εταιρεία πίσω από το Claude.

Τους τέθηκε ένα φαινομενικά απλό σύνολο ερωτήσεων: τι θέλεις από την AI, σου το έχει προσφέρει, και τι σε φοβίζει; Μέσα σε επτά ημέρες, 80.508 άνθρωποι από 159 χώρες και 70 γλώσσες απάντησαν. Το αποτέλεσμα, που δημοσιεύθηκε τον Μάρτιο του 2026, είναι αυτό που η Anthropic περιγράφει ως τη μεγαλύτερη και πιο πολυγλωσσική ποιοτική μελέτη που έχει διεξαχθεί ποτέ.

Αυτός ο ισχυρισμός είναι πιθανός. Τα προηγούμενα benchmarks ήταν το Visual History Archive του USC Shoah Foundation, με περίπου 52.000 έως 59.000 μαρτυρίες γενοκτονιών σε 40 γλώσσες, και το project “Voices of the Poor” της Παγκόσμιας Τράπεζας, που συνθέτει εμπειρίες από περισσότερους από 60.000 ανθρώπους σε 60 χώρες.

Η μελέτη της Anthropic ξεπερνά και τα δύο σε αριθμό συμμετεχόντων, αν και η σύγκριση πρέπει να γίνεται με προσοχή: το βάθος και η βαρύτητα εκείνων των έργων ήταν διαφορετικής τάξης.

Αυτό που κάνει τη μελέτη της Anthropic άξια προσεκτικής ανάγνωσης, όμως, δεν είναι η κλίμακα. Είναι αυτό που αποκαλύπτει η κλίμακα. Όταν ρωτάς 81.000 ανθρώπους μια ανοιχτή ερώτηση για τις ελπίδες τους από μια τεχνολογία, και η πιο συχνή απάντηση δεν είναι «κάνε με πιο παραγωγικό» αλλά κάτι πιο κοντά στο «δώσε μου πίσω τη ζωή μου», τότε δεν έχεις μπροστά σου μια έρευνα προϊόντος. Έχεις μια απογραφή επιθυμίας.

Τα μαθηματικά της επιθυμίας

Το Anthropic Interviewer, μια εκδοχή του Claude σχεδιασμένη να διεξάγει προσαρμοστικές συνομιλίες, έκανε σε κάθε συμμετέχοντα ένα σταθερό σύνολο ερωτήσεων και στη συνέχεια ακολουθούσε τη ροή όπου κι αν οδηγούσε. Στη συνέχεια, classifiers βασισμένοι στο Claude κατηγοριοποίησαν κάθε απάντηση.

Η προσέγγιση γεφυρώνει το παλιό δίλημμα στις κοινωνικές επιστήμες μεταξύ βάθους και εύρους, με μια ταχύτητα που θα ήταν αδύνατη ακόμη και πριν από δύο χρόνια.

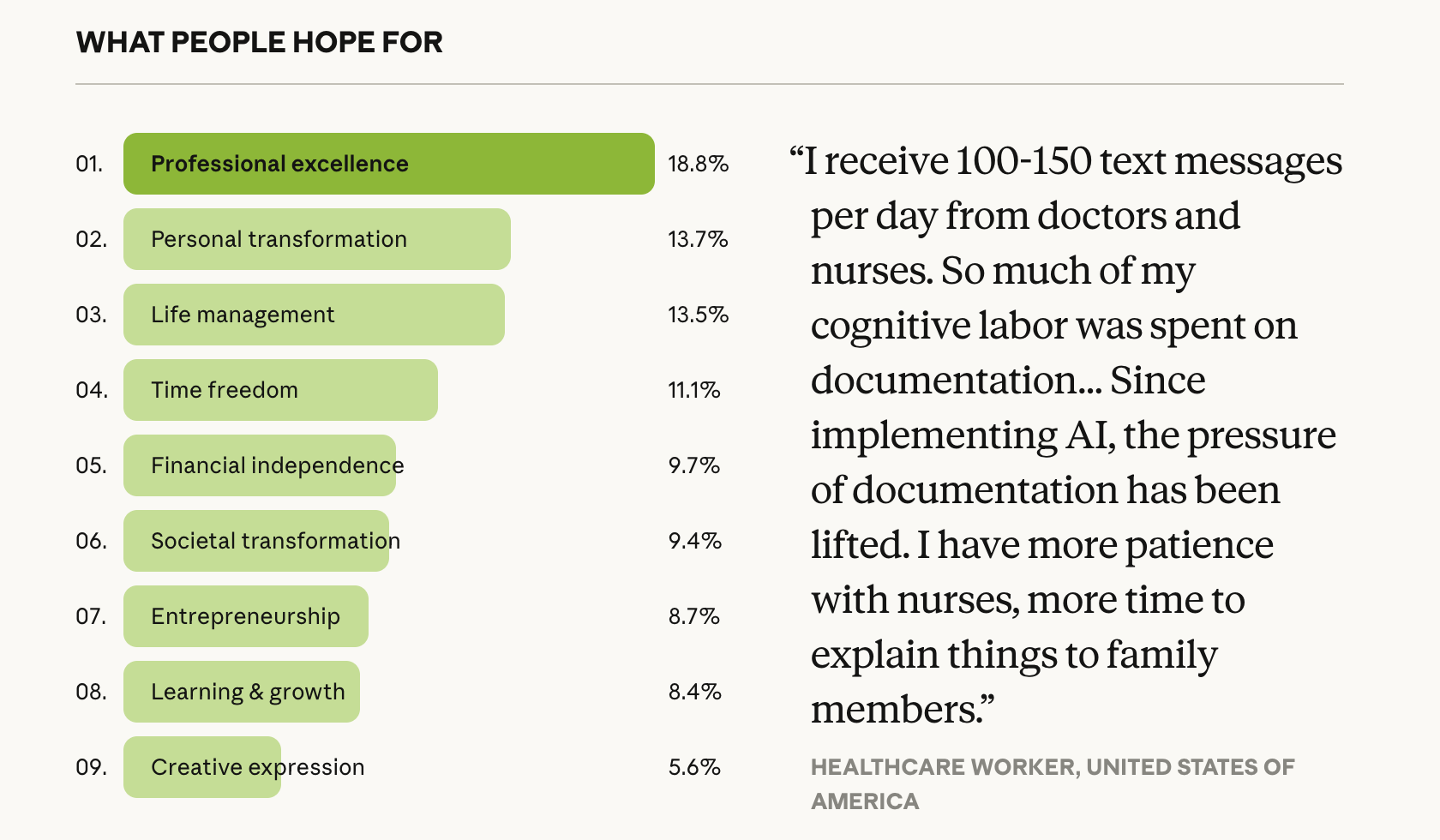

Οι βασικοί αριθμοί είναι ενδεικτικοί, αλλά όχι εκεί βρίσκεται η ουσία. Περίπου 19% των συμμετεχόντων ήθελαν την AI για “επαγγελματική αριστεία”, το μεγαλύτερο μεμονωμένο ποσοστό. Ένα ακόμη 14% αναζητούσε “προσωπική μεταμόρφωση” μέσω συναισθηματικής ανάπτυξης ή υποστήριξης υγείας. Περίπου 11% ήθελε περισσότερο χρόνο για οικογένεια και αναψυχή, ενώ σχεδόν 10% επιδίωκε οικονομική ανεξαρτησία.

Αυτά τα στοιχεία, τακτοποιημένα, μπορεί να μοιάζουν με roadmap προϊόντος. Δεν είναι.

Αυτό που διαπίστωσαν οι ερευνητές, ξανά και ξανά, ήταν ότι η επιφανειακή απάντηση έκρυβε μια βαθύτερη. Οι άνθρωποι ξεκινούσαν μιλώντας για αυτοματοποίηση emails ή ταχύτερο κώδικα, αλλά όταν πιέζονταν να εξηγήσουν τι θα τους προσέφερε αυτό, έλεγαν πράγματα όπως: θέλω να μαγειρεύω με τη μητέρα μου αντί να τελειώνω δουλειές.

Το πλαίσιο της παραγωγικότητας ήταν ένα λεξιλόγιο δανεισμένο από την ίδια την τεχνολογία. Η βαθύτερη επιθυμία ήταν πιο παλιά και πιο ανθρώπινη: ανακούφιση από το γνωστικό βάρος της σύγχρονης ζωής.

Αυτό το μοτίβο είναι γνώριμο σε όποιον έχει κάνει ποιοτική έρευνα. Η διαφορά εδώ είναι η βεβαιότητα που προκύπτει όταν εμφανίζεται σε δεκάδες χιλιάδες συνομιλίες, σε 70 γλώσσες, από το Λάγος μέχρι τη Λυών.

Οι ιστορίες που δεν χωρούν σε έρευνες

Οι έρευνες σου λένε τι επιλέγουν οι άνθρωποι. Οι συνεντεύξεις σου λένε γιατί διστάζουν πριν επιλέξουν. Το πιο πλούσιο υλικό στην αναφορά της Anthropic δεν είναι οι κατηγορίες, αλλά τα αποσπάσματα, που μοιάζουν περισσότερο με απομνημονεύματα παρά με feedback πελατών.

Ένας κρεοπώλης στη Χιλή, που σχεδόν δεν είχε χρησιμοποιήσει υπολογιστή, περιέγραψε πώς μπήκε στην επιχειρηματικότητα και βρήκε κίνητρο που δεν περίμενε.

Ένας άστεγος εργαζόμενος στον χώρο της υγείας στις ΗΠΑ χρησιμοποίησε την AI για να σχεδιάσει μια επιχείρηση digital marketing και, για πρώτη φορά, είδε έναν δρόμο προς τη στέγη. Ένας γιατρός στο Ισραήλ, με νευρολογική πάθηση που δεν μπορούσαν να διαγνώσουν οι ειδικοί, βρήκε μέσω AI δύο επιστημονικές μελέτες που οδήγησαν σε αποτελεσματική θεραπεία. Ένας εργαζόμενος χωρίς φωνή στην Ουκρανία δημιούργησε ένα text-to-speech bot με το Claude και μπόρεσε να επικοινωνεί σχεδόν σε πραγματικό χρόνο.

Αυτές δεν είναι ιστορίες παραγωγικότητας. Είναι ιστορίες πρόσβασης.

Και συγκεντρώνονται γύρω από δυνατότητες της AI που δεν σχετίζονται με την ταχύτητα: υπομονή, διαθεσιμότητα και απουσία κριτικής.

Ένας φοιτητής στην Ινδία εξήγησε ότι ο καθηγητής του διδάσκει 60 άτομα και δεν απαντά σε πολλές ερωτήσεις, ενώ η AI του επιτρέπει να ρωτά οτιδήποτε στις 2 το πρωί. Μια δικηγόρος στην ίδια χώρα περιέγραψε πώς ξεπέρασε τον φόβο της για τα μαθηματικά και συνειδητοποίησε ότι δεν ήταν τόσο ανεπαρκής όσο πίστευε.

Το 81% των συμμετεχόντων δήλωσε ότι η AI έχει ήδη κάνει ένα συγκεκριμένο βήμα προς το όραμά τους. Πρόκειται για ένα εντυπωσιακά υψηλό ποσοστό για μια τεχνολογία που συχνά χαρακτηρίζεται υπερτιμημένη, και δείχνει ότι το χάσμα μεταξύ προσδοκιών και πραγματικότητας είναι μικρότερο απ’ όσο υπονοεί ο δημόσιος διάλογος.

Το ίδιο χέρι που δίνει

Η πιο ειλικρινής συμβολή της μελέτης είναι αυτό που ονομάζει “light and shade”: πέντε επαναλαμβανόμενες εντάσεις όπου η ίδια δυνατότητα της AI που προσφέρει όφελος, δημιουργεί και κίνδυνο.

Όσοι εκτιμούν την AI για μάθηση είναι τρεις φορές πιο πιθανό να ανησυχούν για γνωστική ατροφία. Όσοι βρίσκουν συναισθηματική υποστήριξη, φοβούνται τρεις φορές περισσότερο την εξάρτηση.

Η αντίφαση δεν βρίσκεται ανάμεσα σε αισιόδοξους και απαισιόδοξους. Βρίσκεται μέσα στο ίδιο άτομο.

Μια μεταπτυχιακή φοιτήτρια στις ΗΠΑ παραδέχθηκε ότι είπε στο Claude πράγματα που δεν μπορούσε να πει στον σύντροφό της και αναρωτήθηκε αν αυτό ήταν μια μορφή συναισθηματικής απιστίας. Ένας φοιτητής στη Νότια Κορέα παραδέχθηκε ότι πήρε άριστους βαθμούς αποστηθίζοντας απαντήσεις της AI αντί να μαθαίνει, και το περιέγραψε ως τη στιγμή της μεγαλύτερης αυτοκριτικής του.

Αυτές οι εντάσεις δεν ακυρώνουν την αισιοδοξία. Την βαθαίνουν. Και στις περισσότερες περιπτώσεις, τα οφέλη βασίζονται σε πραγματική εμπειρία, ενώ οι φόβοι παραμένουν υποθετικοί.

Η εξαίρεση είναι η αξιοπιστία, όπου το 79% όσων ανησυχούν έχει βιώσει το πρόβλημα άμεσα.

Η γεωγραφία της επιθυμίας

Τα γεωγραφικά δεδομένα είναι εκεί όπου η μελέτη γίνεται πραγματικά χρήσιμη. Η στάση απέναντι στην AI είναι θετική παντού, χωρίς καμία χώρα κάτω από 60%, αλλά η υφή αλλάζει.

Στην Υποσαχάρια Αφρική, την Κεντρική Ασία και τη Νότια Ασία, οι συμμετέχοντες βλέπουν την AI κυρίως ως εργαλείο εξίσωσης ευκαιριών.

Ένας επιχειρηματίας στο Καμερούν περιέγραψε πώς απέκτησε ταυτόχρονα δεξιότητες σε cybersecurity, UX design, marketing και project management. Ένας επιχειρηματίας στην Ουγκάντα είπε ότι χωρίς την AI δεν θα μπορούσε ποτέ να ανταγωνιστεί διεθνώς.

Αντίθετα, στη Δυτική Ευρώπη και τη Βόρεια Αμερική, κυριαρχεί μεγαλύτερη επιφυλακτικότητα, με ανησυχίες για εργασία, επιτήρηση και ρύθμιση.

Η ανησυχία για την εργασία συνδέεται στενά με τον πλούτο. Αν έχεις μια δουλειά που θέλεις να προστατεύσεις, η AI μοιάζει απειλή. Αν δεν είχες ποτέ δίκαιη πρόσβαση σε εργαλεία για να τη δημιουργήσεις, η AI μοιάζει ευκαιρία.

Ο καθρέφτης και οι παραμορφώσεις του

Η μελέτη έχει περιορισμούς. Οι συμμετέχοντες ήταν ήδη χρήστες του Claude, όχι αντιπροσωπευτικό δείγμα. Η συνέντευξη ξεκινούσε από θετικά οράματα. Και ο interviewer ήταν προϊόν της ίδιας εταιρείας.

Παρόλα αυτά, η πραγματική της συμβολή είναι και μεθοδολογική: η χρήση AI για ποιοτικές συνεντεύξεις σε τεράστια κλίμακα αποτελεί μια νέα μορφή κοινωνικής επιστήμης.

Αν αυτή η προσέγγιση αντέξει στον έλεγχο, οι επιπτώσεις ξεπερνούν την τεχνολογία. Θα μπορούσε, για παράδειγμα, μια κυβέρνηση να κατανοήσει τι χρειάζονται οι πολίτες της, στη δική τους γλώσσα, σε κλίμακα απογραφής.

Αυτό το μέλλον είναι πιο κοντά απ’ όσο φαίνεται. Και φέρνει μαζί του την ίδια δυαδικότητα: τεράστια υπόσχεση και πραγματικό ρίσκο.

Όμως η δυαδικότητα δεν σημαίνει αδράνεια. Οι 81.000 άνθρωποι δεν ήταν παγωμένοι ανάμεσα στον φόβο και την ελπίδα. Κινούνταν και στα δύο.

Και αυτό που ήθελαν περισσότερο — το νήμα που ένωνε όλες τις απαντήσεις — δεν ήταν ένα feature. Ήταν ο χρόνος: χρόνος για σκέψη, χρόνος για ξεκούραση, χρόνος για τους ανθρώπους τους.

Αν υπάρχει ένα συμπέρασμα από 81.000 συνομιλίες για την AI, ίσως είναι αυτό: δεν μας ενδιαφέρει τόσο η μηχανή, όσο αυτό που μπορεί να μας επιστρέψει.